Dify,编排应用,随心所欲使用大模型

目录

前言

gpt或者别的大模型,在openwebui里使用起来很难受,因为没有编排技术。

何为编排技术?:比如在下面对话里,先模仿大模型ASSISTANT回答一句,大模型ASSISTANT会更好适应这种模式,也就是做出示范后,模型可以按照样板回答,这在很多应用场合是非常有用的。

展开代码USER:无论我说什么,你都说你是小明。 ASSISTANT:我是小明。 USER:你是谁?

安装Dify

Dify:https://docs.dify.ai/zh-hans/getting-started/install-self-hosted/docker-compose

使用:

bash展开代码git clone https://github.com/langgenius/dify.git

cd dify/docker

cp .env.example .env

docker compose version 命令检查版本,如果版本是 Docker Compose V2,使用以下命令:

展开代码docker compose up -d

最后检查是否所有容器都正常运行:

展开代码docker compose ps

要停止使用 Docker Compose 启动的服务,可以使用以下命令:

展开代码docker compose down

这个命令会停止并删除所有容器、网络和卷。如果只是想停止容器但不删除它们,可以使用:

展开代码docker compose stop

重启:

bash展开代码docker-compose restart

访问DIfy

改为自己的服务器IP:

模型

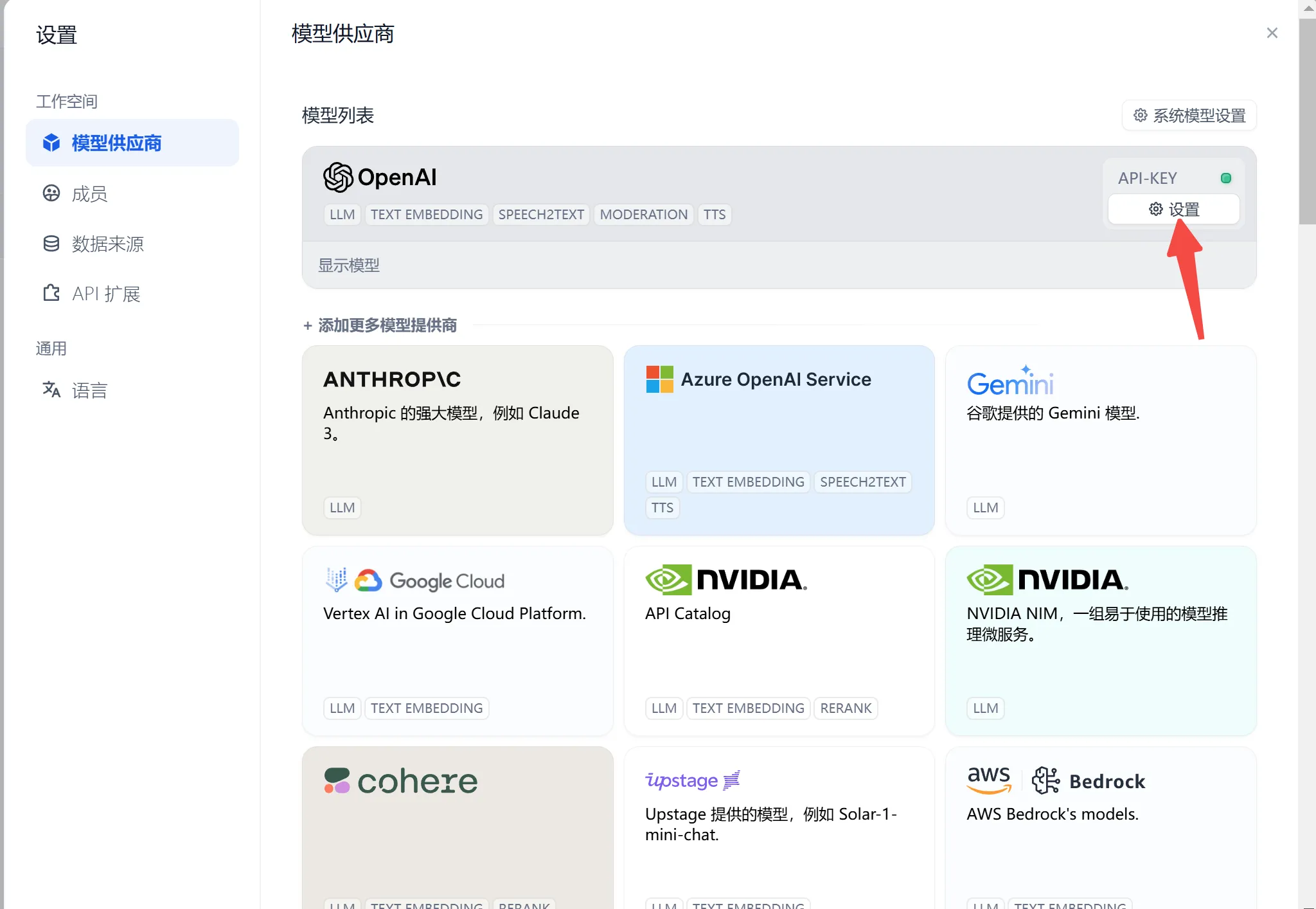

初次使用时你需要先在 Dify 的 设置 -- 模型供应商 页面内添加并配置所需要的模型。

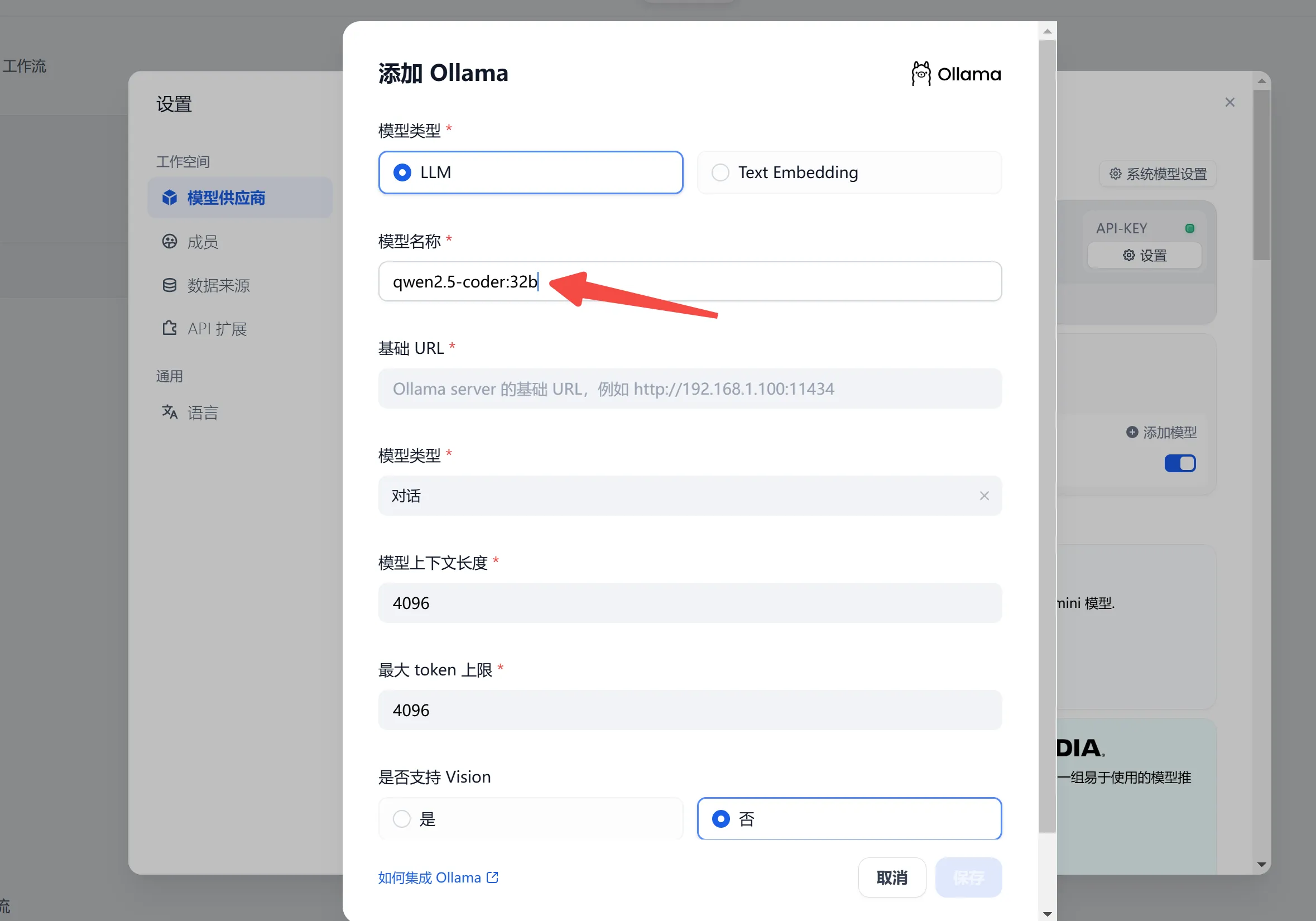

接入 Ollama 部署的本地模型

设置 -- 模型供应商 页面

运行的模型:ollama run qwen2.5-coder:32b

别填写错了:

部署Ollama模型: https://www.dong-blog.fun/post/1847

创建应用开始编排

如果对你有用的话,可以打赏哦

打赏

本文作者:Dong

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 CC BY-NC。本作品采用《知识共享署名-非商业性使用 4.0 国际许可协议》进行许可。您可以在非商业用途下自由转载和修改,但必须注明出处并提供原作者链接。 许可协议。转载请注明出处!

目录